Apple ha dato il suo contributo nello sviluppo di MGIE, un editor di immagini basato sull’intelligenza artificiale capace di modificare immagini sulla base di istruzioni testuali.

Apple ha collaborato con i ricercatori dell’Università della California, Santa Barbara, per mettere a punto “MGIE“, un nuovo modello di intelligenza artificiale che è capace di modificare le immagini sulla base di istruzioni testuali in linguaggio naturale. Trattandosi di un progetto dal codice sorgente aperto MGIE viene distribuito tramite il portale di progetti open source GitHub ma, come segnalato dal sito Venturebeat, si può anche provare attraverso una demo web disponibile su Hugging Face Spaces.

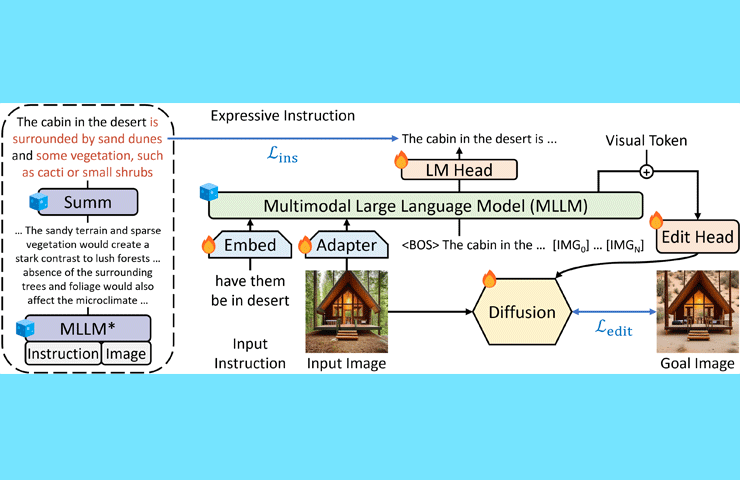

Come descritto nella panoramica del progetto su GitHub, MGIE è “un’implementazione di editing di immagini basato su istruzioni guidate tramite modelli linguistici multimodali di grandi dimensioni“. Questo MLLM-Guided Image Editing è stato anche presentato alla Conferenza internazionale sulle rappresentazioni dell’apprendimento (ICLR) 2024.

MGIE, come funziona l’editor intelligente basato su IA sviluppato anche da Apple

Per descriverlo nel modo più semplice possibile, questo modello è in grado di comprendere il contesto delle immagini e modificarle applicando modifiche sulla base di richieste di testo scritte in un linguaggio naturale, anche semplici e non troppo specifiche. Come esempio, si può partire dalla foto di una capanna in legno in mezzo ad un fitto bosco con tanta vegetazione per trasformarla in una “capanna nel deserto circondata da dune di sabbia e da un po’ di vegetazione, come cactus o piccoli arbusti“. Per fare un altro esempio, lo strumento si può utilizzare anche per trasformare il cottage in una foto in una villa.

Fino ad oggi abbiamo avuto modo di conoscere strumenti alimentati dall’intelligenza artificiale capaci di generare immagini partendo da una semplice istruzione di testo. MGIE non ha lo scopo di generare nuove immagini ma, piuttosto, di modificare in maniera intelligente immagini che già esistono. Qualcosa di simile all’editor in-chat chiamato ‘Designer’ che Microsoft ha implementato recentemente nel suo Copilot per permettere di personalizzare le immagini generate con il modello d’IA Dall-E 3 di OpenAI.

MGIE funziona in maniera molto semplice. Partendo da una immagine esistente si può chiedere a MGIE di modificarla attraverso modifiche più o meno avanzate. L’immagine si può semplicemente ritagliare, ridimensionare, capovolgere o ruotare così come sistemare in termini di bilanciamento colori, luminosità, nitidezza e contrasto. In forma più avanzata è possibile chiedere al modello di applicare filtri o di aggiungere/rimuovere elementi o sfocare lo sfondo. MGIE può persino modificare elementi specifici presenti nell’immagine, tra cui volti e occhi di persone ma anche oggetti inanimati.

Apple e l’IA generativa: la vedremo mai su iPhone e iPad?

Da sottolineare che il coinvolgimento di Apple nello sviluppo del modello MGIE non significa che vedremo questo strumento d’IA in prodotti o servizi dell’azienda di Cupertino. Conferma però il fatto che anche l’azienda di Cupertino ha un certo interesse nel campo dell’intelligenza artificiale generativa. Negli ultimi mesi si è parlato molto del fatto che Apple stia lavorando allo sviluppo di una propria IA generativa, con tanto di previsione che iPhone e iPad in arrivo nel 2024 potrebbero disporre di nuove e potenti funzionalità basate sull’intelligenza artificiale. La concorrenza avanza, nel frattempo.